Вчера в 20:00 по московскому времени OpenAI в прямом эфире показали свою революционную модель GPT-4o. Общаться с ней можно голосом и даже по видео, при этом вообще без задержек. А еще GPT-4o понимает тон голоса, может шутить, отвечать с (почти) человеческой интонацией, переводить в режиме реального времени и даже петь. Действительно можно поверить, что разговариваешь с живым собеседником.

При этом GPT-4o может выступать не только собеседником, но и переводчиком. Разработчики значительно улучшили способности модели в диалогах на отличных от английского языках, теперь она поддерживает более 50 языков. К тому же, была улучшена память модели: теперь она будет запоминать все беседы с пользователем и знать о вас больше.

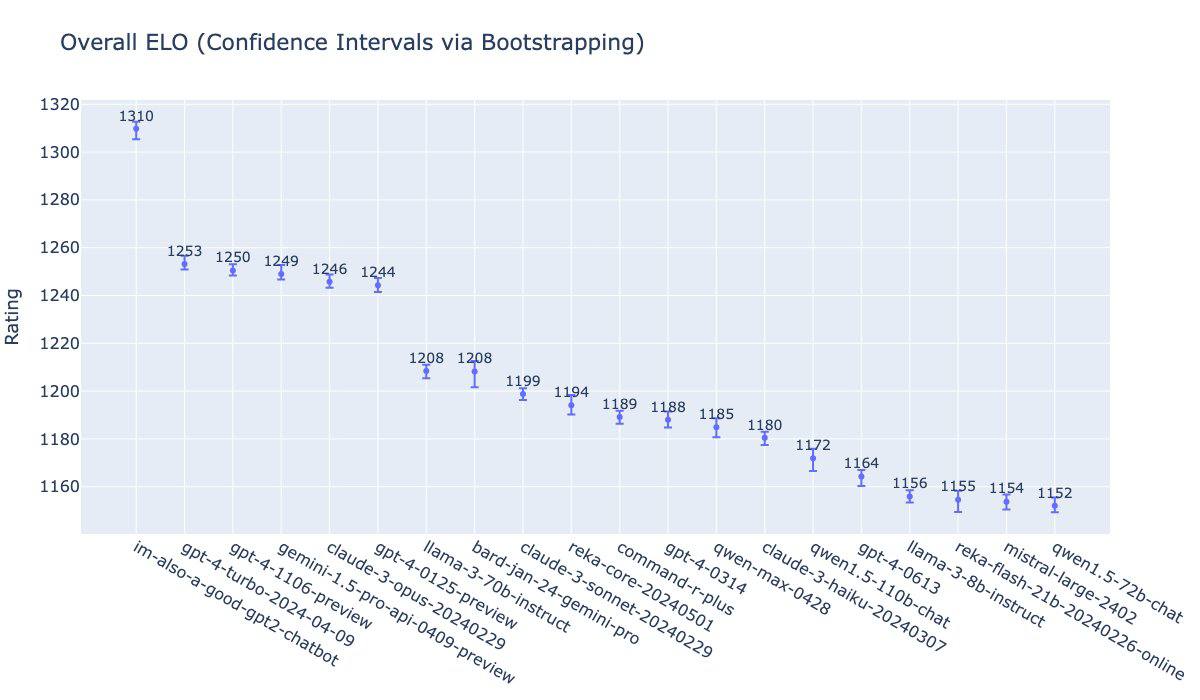

Сейчас на Chatbot Arena по сравнению с конкурентами GPT-4o показывает отрыв в 57 ELO на общих языковых задачах и в 100 ELO на коде. Это поразительный результат. Кроме этого, модель использует для ответов не только свои знания, но и информацию из Интернета.

И, кстати, теперь еще у модели еще будет режим стриминга для MacOS. Подключаете приложение, выделяете прямо на экране код, модель его обрабатывает на месте.

И, кстати, теперь еще у модели еще будет режим стриминга для MacOS. Подключаете приложение, выделяете прямо на экране код, модель его обрабатывает на месте.

Но и это еще не все! С картинками и видео модель теперь тоже работает намного лучше: может синтезировать объекты в 3D, осуществлять продвинутый анализ графиков, диаграмм, таблиц и рукописного текста. Также, в отличие от предшественников, GPT-4o не просто умеет генерировать картинки, а запоминать внешность персонажей. За счет этого можно сгенерировать полноценный комикс!

Но и это еще не все! С картинками и видео модель теперь тоже работает намного лучше: может синтезировать объекты в 3D, осуществлять продвинутый анализ графиков, диаграмм, таблиц и рукописного текста. Также, в отличие от предшественников, GPT-4o не просто умеет генерировать картинки, а запоминать внешность персонажей. За счет этого можно сгенерировать полноценный комикс!

Буква 'o' в названии GPT-4o означает "omni", то есть "универсальная". До ее появления тоже можно было отсылать боту картинки и использовать голосовой режим. Однако задержка ответа была в районе 3 секунд. Теперь модель отвечает со скоростью человека. Это происходит за счет того, что теперь голосовой режим работает не за счет последовательности моделей, как это было раньше, а за счет одной GPT-4o, которую обучали сразу на тексте, аудио, изображениях.

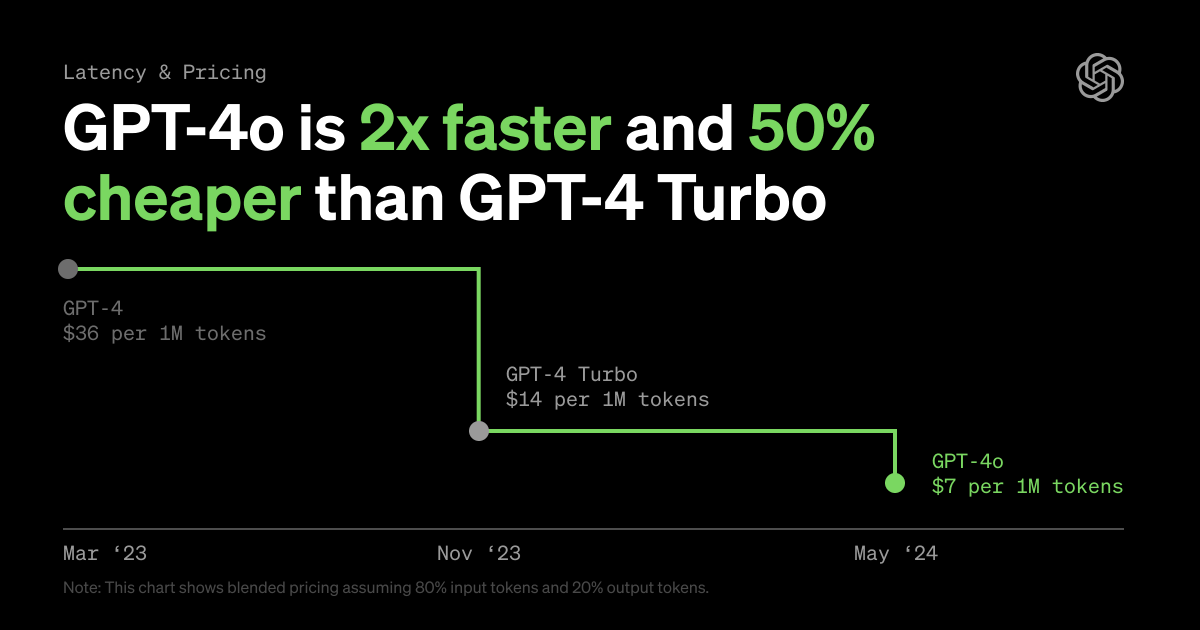

Модель будет доступна даже для бесплатных юзеров бота. По API обработка токена станет в 2 раза дешевле, чем в GPT-4 Turbo. Цену удалось снизить в основном за счет нового мультиязычного токенизатора, который лучше "сжимает" вход. Для некоторых языков теперь требуется в 3-4 раза меньше токенов, соответственно и стоит обработка промпта теперь меньше. Например, для русского языка она будет обходится в среднем в 3.5 раза дешевле.

Модель будет доступна даже для бесплатных юзеров бота. По API обработка токена станет в 2 раза дешевле, чем в GPT-4 Turbo. Цену удалось снизить в основном за счет нового мультиязычного токенизатора, который лучше "сжимает" вход. Для некоторых языков теперь требуется в 3-4 раза меньше токенов, соответственно и стоит обработка промпта теперь меньше. Например, для русского языка она будет обходится в среднем в 3.5 раза дешевле.

Также OpenAI пообещала выпустить приложение для ПК.